La UE aprieta el paso: arranca la regulación de la IA y la defensa efectiva de los derechos de autor

El 2 de agosto entra en vigor en la Unión Europea un pilar clave del nuevo Reglamento de Inteligencia Artificial (RIA). Por primera vez, los grandes modelos de IA como ChatGPT, Gemini o Claude estarán obligados a rendir cuentas sobre cómo se entrenan y con qué datos. Una decisión histórica que pone sobre la mesa una pregunta urgente: ¿quién controla la tecnología que lo está transformando todo?

Derechos de autor, transparencia y desinformación: lo que exige la nueva norma

Desde esta semana, los proveedores de modelos de propósito general (GPAI, por sus siglas en inglés) deberán:

- Publicar documentación técnica detallada sobre el funcionamiento de sus sistemas.

- Informar del origen, fuente y fecha de los datos empleados en el entrenamiento.

- Respetar la legislación europea en materia de propiedad intelectual.

- Colaborar con la nueva autoridad comunitaria (AI Office), encargada de supervisar el cumplimiento, auditar modelos y, si es necesario, imponer sanciones.

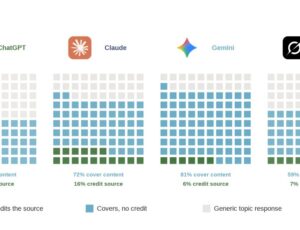

Por qué esto afecta directamente a los medios

Durante años, las grandes tecnológicas han entrenado sus sistemas con contenido extraído sin permiso: artículos de prensa, imágenes de agencias, entrevistas completas. Todo sin preguntar, sin citar y sin pagar. El nuevo reglamento europeo pone límites a estas prácticas y refuerza el derecho de los medios a decidir sobre el uso de sus contenidos. Si un editor ha reservado expresamente sus derechos —como permite la Directiva europea 2019/790—, cualquier uso por parte de una IA deberá contar con su autorización.

No importa dónde se haya entrenado el modelo: si opera en Europa, tendrá que respetar esta norma. Se trata de un cambio estructural que permite a los medios reclamar compensaciones económicas y bloquear usos abusivos.

Etiquetar lo falso, proteger lo real

El reglamento también obliga a que los contenidos generados artificialmente estén debidamente etiquetados. Es decir: que los deepfakes y los textos sintéticos no puedan pasar por reales sin control. Esta medida no solo protege a los lectores, sino que da a los medios nuevas herramientas para combatir la desinformación y verificar con mayor agilidad.

Además, reconoce que los grandes modelos de IA pueden generar riesgos sistémicos para la democracia, la seguridad o la economía. Por eso, introduce obligaciones adicionales: evaluaciones de impacto, informes periódicos de transparencia y notificación de incidentes graves.

Una IA más transparente para las redacciones

Cada vez más medios utilizan herramientas de IA en sus rutinas. Saber cómo funcionan, qué sesgos arrastran y con qué datos se entrenan no es una curiosidad técnica, sino una exigencia ética y profesional. Esta legislación abre por fin una puerta a una IA auditable, comprensible y alineada con los valores del periodismo.

Empieza la cuenta atrás

Lo que arranca ahora no es el final del proceso, sino su punto de partida. Algunas disposiciones clave, especialmente las relativas a los modelos más potentes, entrarán plenamente en vigor este 2 de agosto de 2025. Las sanciones llegarán en 2026. El incumplimiento podrá suponer multas de hasta 15 millones de euros o el 3 % de la facturación global.

Para los medios, este calendario no es solo un marco legal. Es una oportunidad. De defender su propiedad intelectual. De reclamar un papel legítimo en el nuevo ecosistema digital. Y de recordar que, en tiempos de algoritmos, el periodismo sigue siendo un pilar irrenunciable de la democracia.